最近在折腾 NAS 上的 AI 应用,整理了一个比较适合自托管的中文 TTS 项目:AngeVoice。

项目地址:

https://github.com/ang77712829/AngeVoice

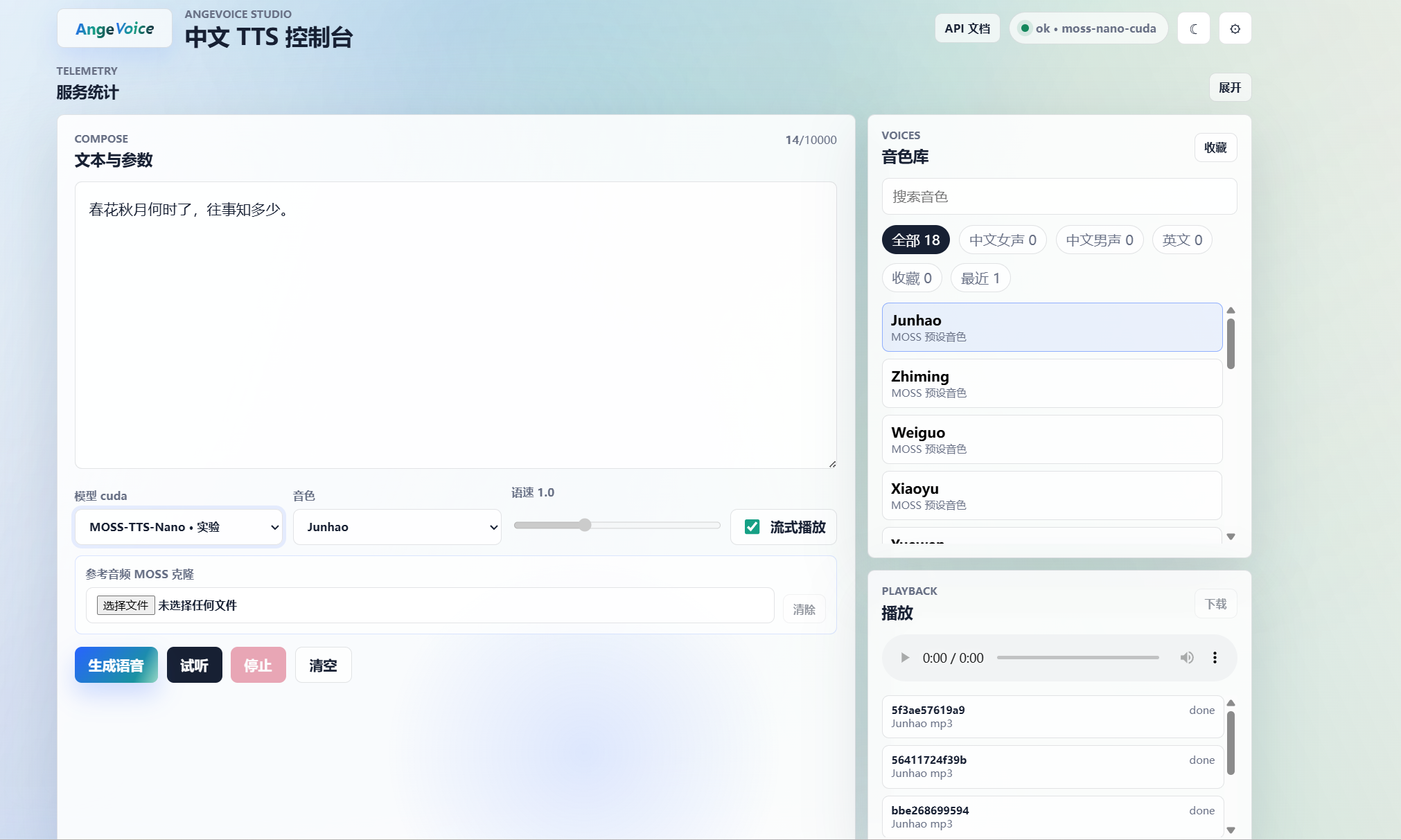

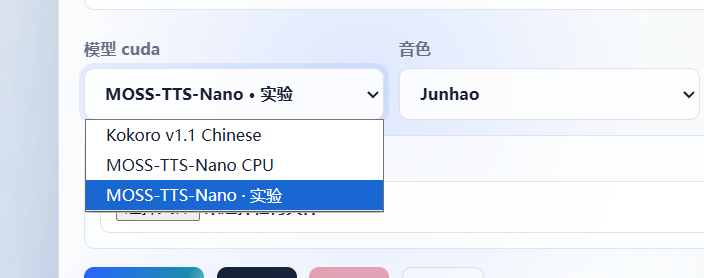

AngeVoice 不是重新训练的新模型,而是把 Kokoro 中文 TTS 和可选的 MOSS-TTS-Nano 封装成一个更适合 NAS / Docker 长期运行的语音合成服务。

简单来说,就是可以把 NAS 变成一个本地文字转语音服务,用来给 AI 助手、阅读器、有声书、小智后端、自动化脚本等提供语音输出。

主要功能:

• 支持中文 TTS 语音合成

• 内置 Web UI,可以直接浏览器输入文字生成语音

• 支持 OpenAI 兼容接口 /v1/audio/speech

• 支持 WebSocket 流式输出

• 支持批量合成 ZIP

• 支持 Kokoro,MOSS-TTS-Nano 可选开启

• 支持 Docker CPU / GPU 部署

• 有健康检查、请求统计、缓存、限流等服务化功能

我觉得它比较适合 NAS 用户的地方是:

它不是单纯的模型推理脚本,而是更像一个可以长期运行的本地 TTS 服务。部署好以后,内网其他应用都可以通过 API 调它。

比如可以用在:

• AI Agent 语音回复

• 小智 ESP32 / 智能音箱后端

• 阅读器朗读

• 有声书生成

• 自动化脚本语音播报

• 视频配音草稿

• 家庭通知提醒

部署方面目前主要推荐 Docker。

CPU 版:

git clone https://github.com/ang77712829/AngeVoice.git

cd AngeVoice/docker/cpu

docker compose up -d

GPU 版:

git clone https://github.com/ang77712829/AngeVoice.git

cd AngeVoice/docker/gpu

docker compose up -d

默认端口:

CPU:http://你的NAS地址:8100

GPU:http://你的NAS地址:8101

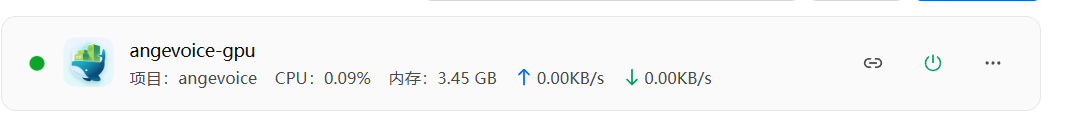

硬件方面,如果只是体验 Kokoro,普通 CPU 也能跑,建议 8GB 内存以上,16GB 更舒服。

如果要折腾 MOSS 或参考音频克隆,最好有 NVIDIA 显卡,CPU 上体验可能会比较慢。

目前项目还在持续完善,适合喜欢折腾 Docker、AI、本地语音服务的 NAS 用户。

如果只是想找一个手机上点开即用的 TTS App,它可能不是最简单的选择;但如果想在 NAS 上自建一个中文 TTS 后端,还是挺值得试试的。

项目地址:

https://github.com/ang77712829/AngeVoice

欢迎大家测试反馈,也可以联系我在线进行试用,我目前的 NAS 配置是 i3-9100T + 16GB 内存 + Tesla P4。Kokoro 流式生成速度还不错,MOSS 也可以折腾,但这类轻量 TTS 模型本身参数规模有限,音质和自然度不能和大型商业 TTS 服务硬比,更适合本地化、自托管、低成本使用场景。