Super Agent Party:

一款拥有无限可能的 3D 版 AI 桌面伴侣!支持接入QQ/B站直播、RAG、联网、长期记忆、 酒馆角色卡、代码沙盒、表情包、浏览器控制、Dify、 Home Assistant、MCP、A2A、Comfyui等功能!

核心功能:

- • 无缝能力增强:无需代码改造即可实现LLM API企业级升级,为现有模型接口无缝集成知识库、实时联网、永久记忆、兼容酒馆(SillyTavern)角色卡、代码执行、多模态能力(视觉/绘图/听觉/语音)、自动化能力(控制智能家居、控制浏览器)、深度思考控制与研究等模块化功能,打造可插拔的LLM增强中台。

- • 全渠道一键部署:支持将智能体配置快速部署至多类终端,已兼容经典聊天界面、QQ官方机器人、B站直播互动、VRM虚拟桌宠等场景,开箱即用。

- • 生态工具互联:可自由接入第三方智能体与工作流作为工具链(已适配Dify/ComfyUI/MCP/A2A等系统),通过agent-party架构实现跨平台能力聚合。

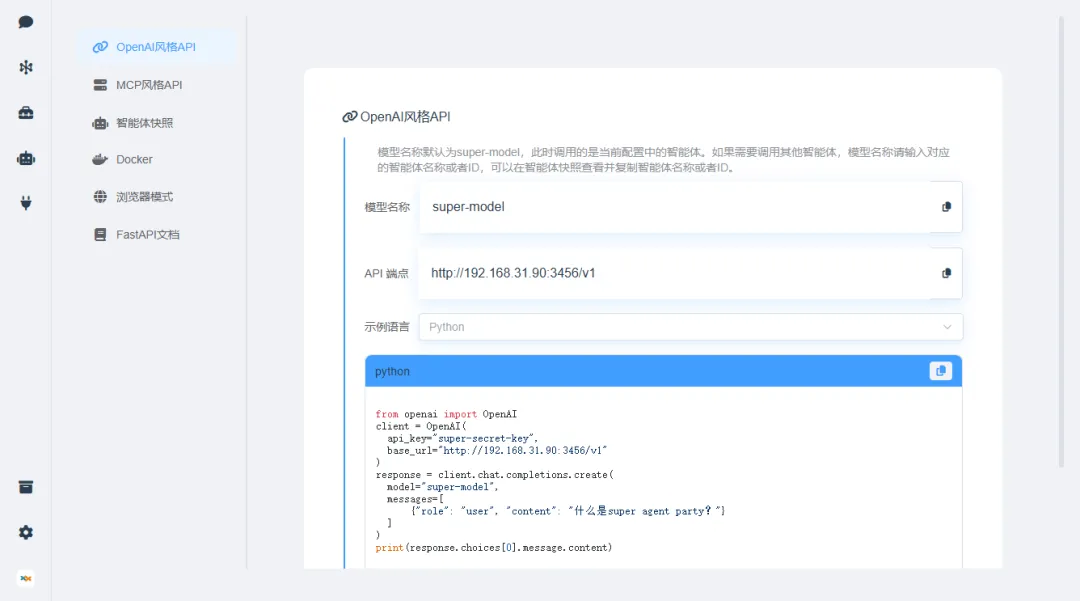

- • 标准化接口开放:提供OpenAI API兼容接口及MCP协议支持,便于开发者直接对接外部系统,实现智能体能力的快速转接与二次开发。

- • 全平台兼容适配:覆盖Windows/macOS/Linux原生运行环境,支持Docker容器化部署与Web端云服务,满足多场景技术栈需求。

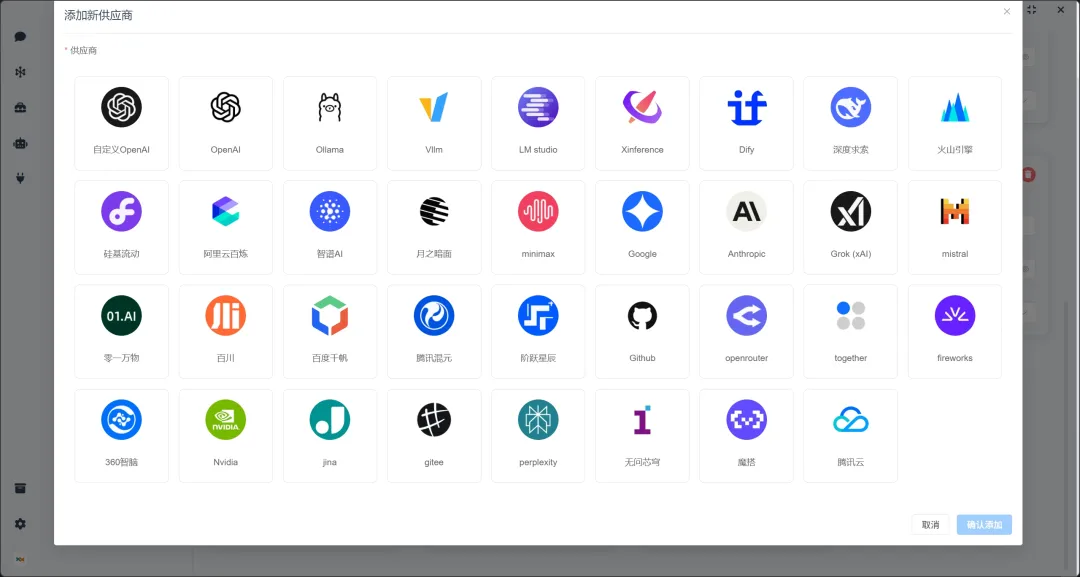

多服务商支持:本地部署引擎(ollama/dify等等)以及云服务商接口均支持

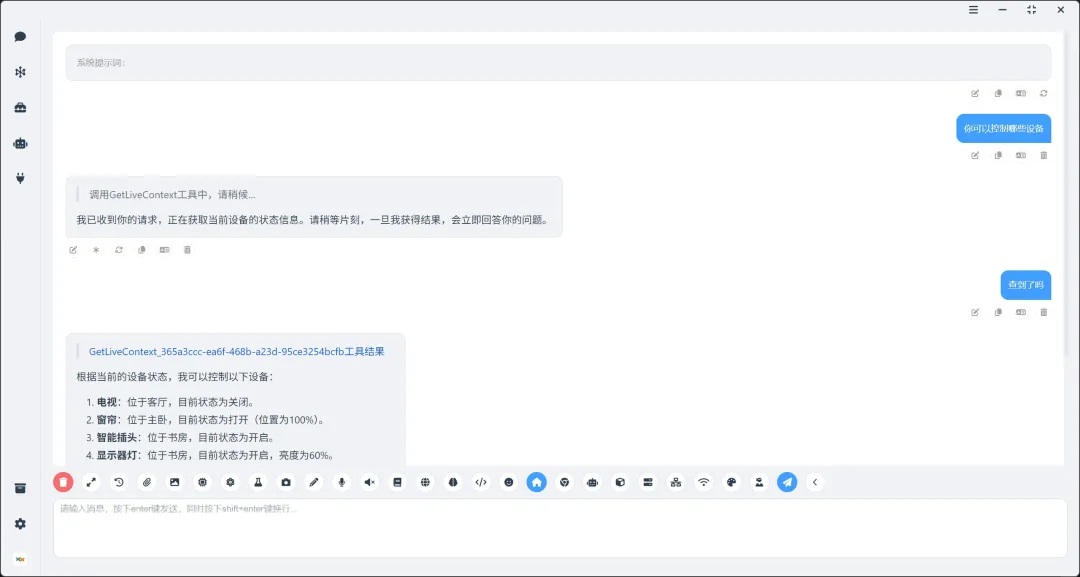

海量工具:内置各种工具(如知识库、联网、智能家居、浏览器控制),支持异步调用,不阻塞智能体回复

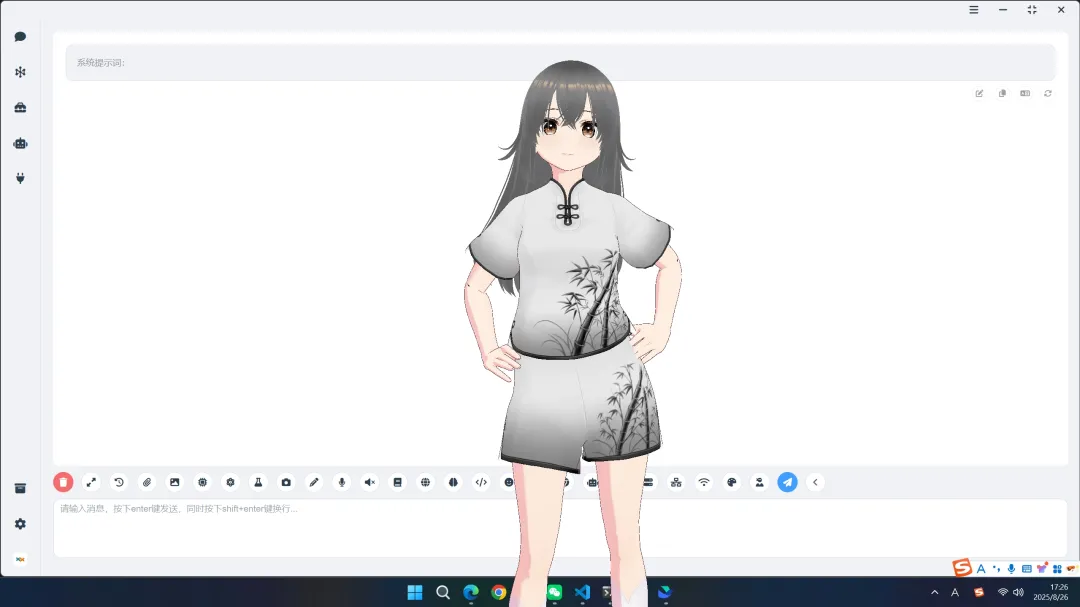

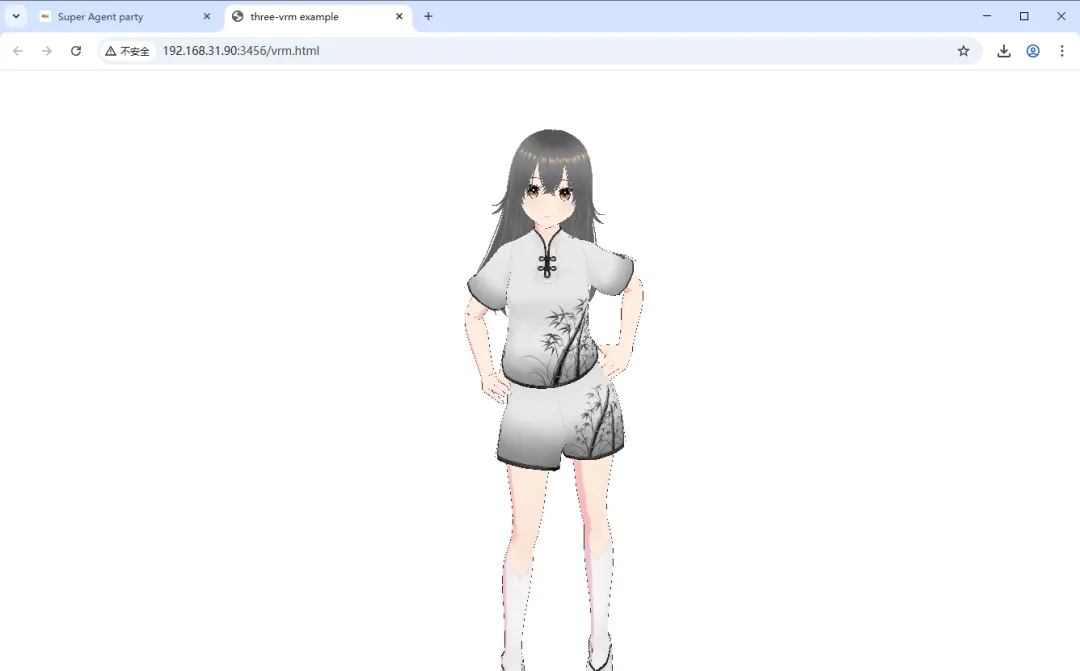

VRM桌宠:支持上传自定义VRM模型,打造专属桌面伴侣

酒馆角色卡:支持酒馆角色卡,支持长期记忆

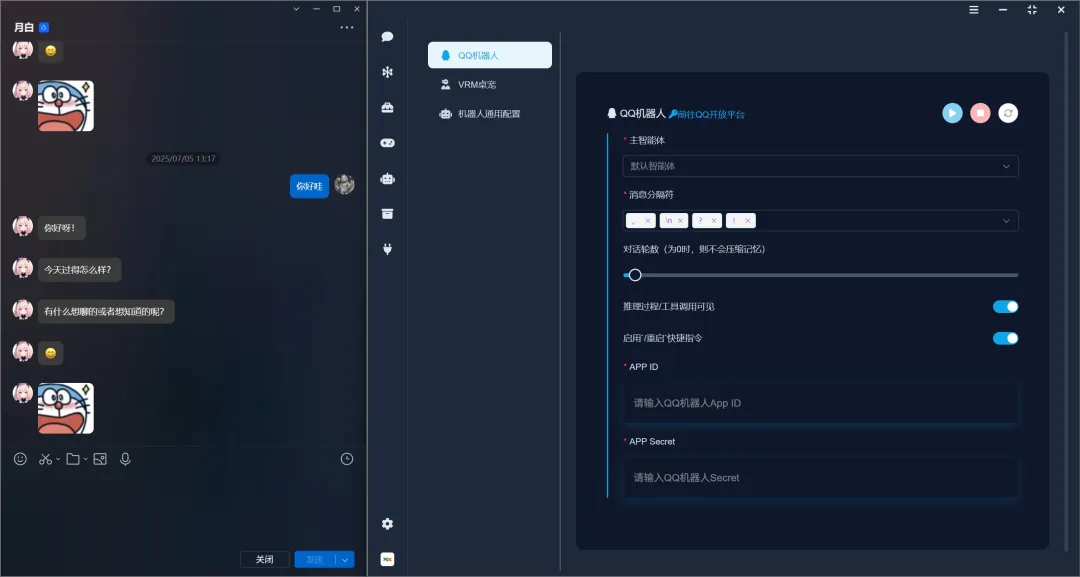

QQ机器人:支持一键部署到QQ官方机器人,方便用户随时随地使用智能体

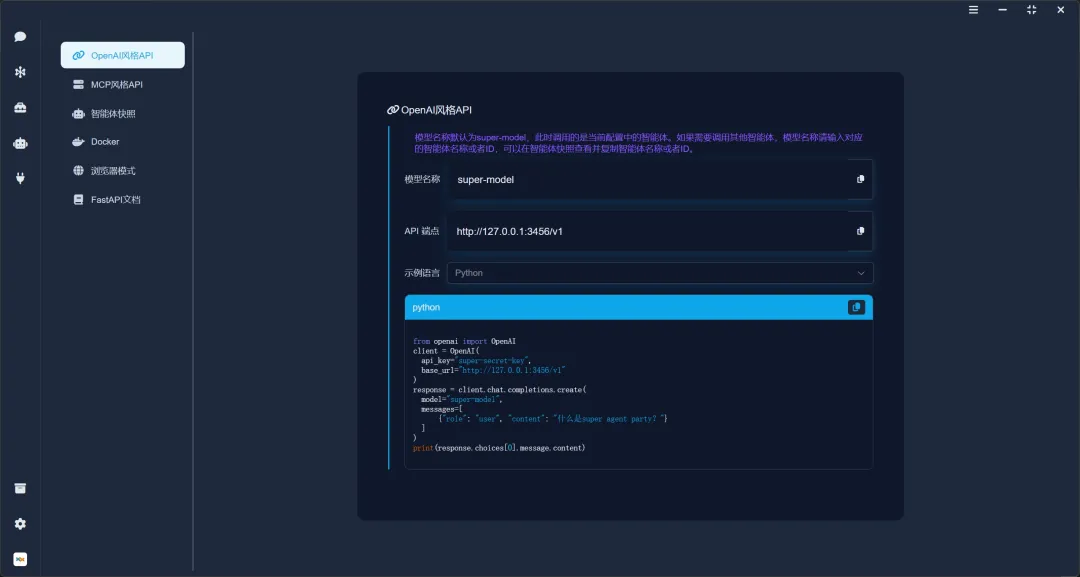

开发者友好:开放openai API接口、MCP接口,可以将智能体对外转接

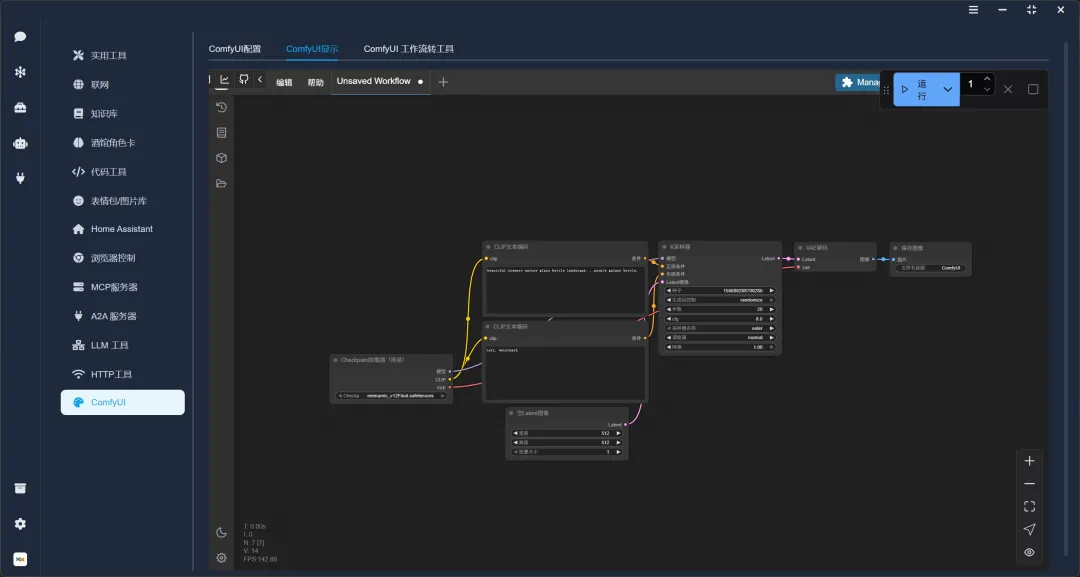

接入comfyui:将comfyui工作流转换为智能体工具,多comfyui服务器负载均衡

硬件要求:

安装

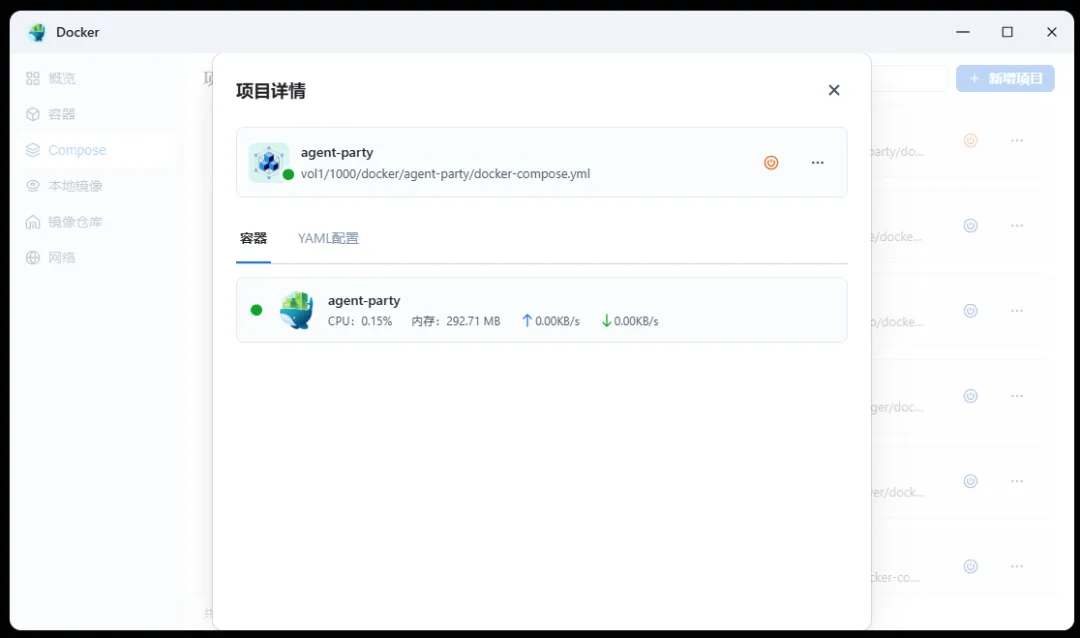

Docker Compose

services:

agent-party:

image: ailm32442/super-agent-party:latest

container_name: agent-party

ports:

- 3456:3456

volumes:

- ./data:/app/data

restart: always

使用

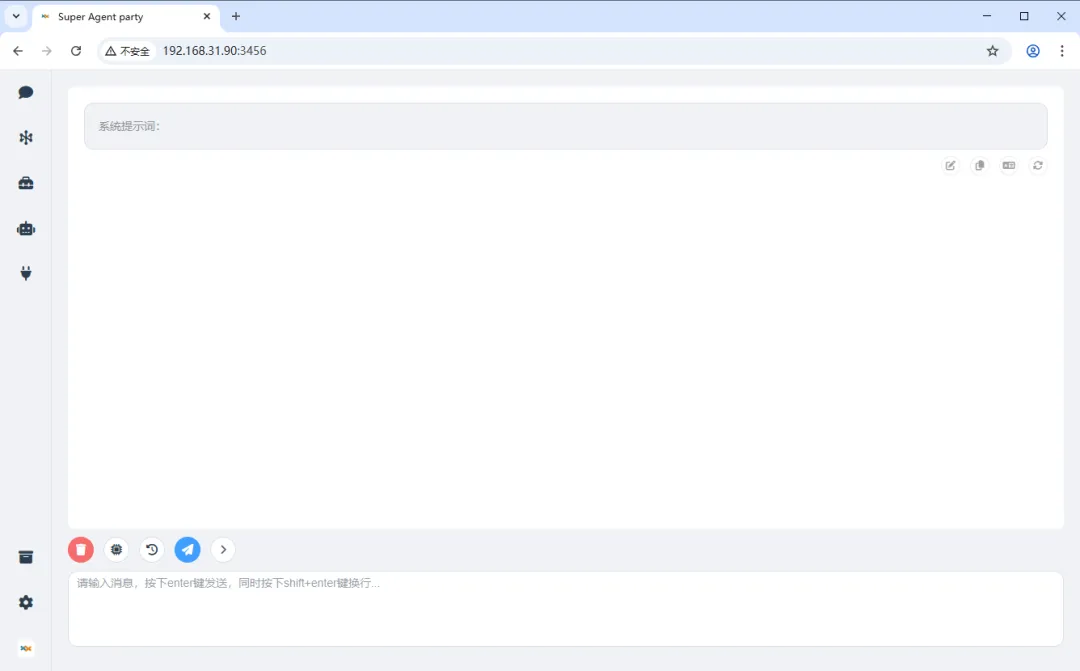

浏览器中输入 http://NAS的IP:3456 就能看到界面

界面非常简洁,但功能还不少

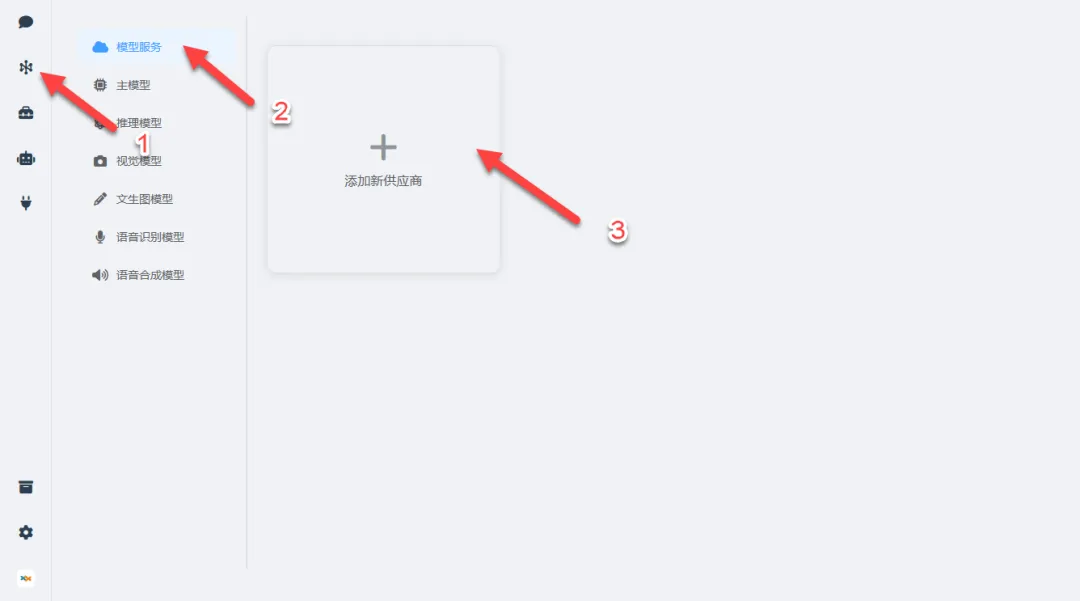

来到模型配置,首先添加一个供应商

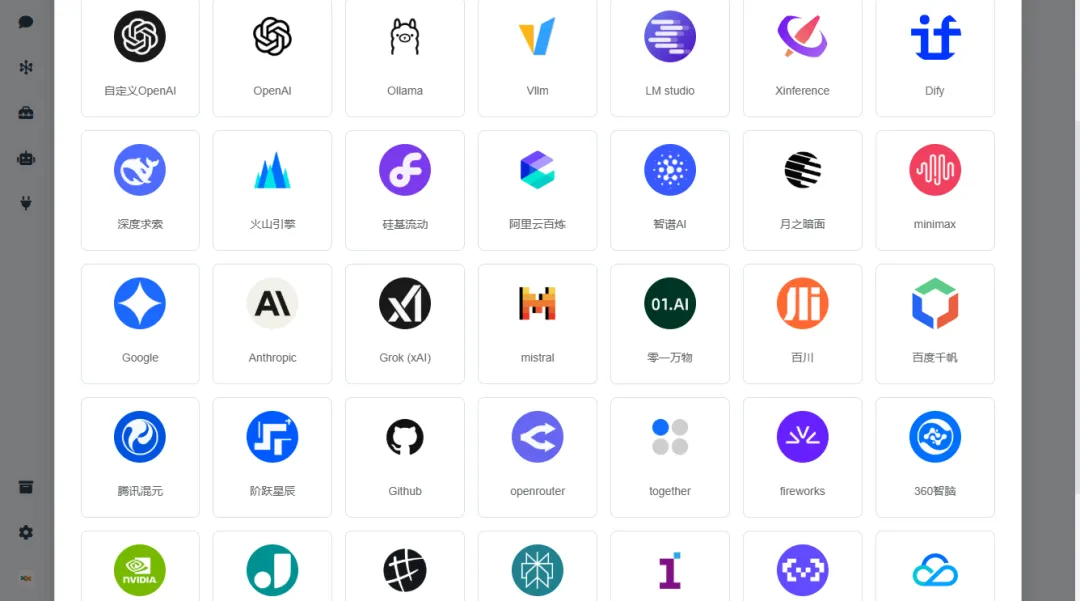

一眼看过去,支持的模型供应商种类丰富,尤其对国内供应商的

以对接 Ollama 为例,分别添加推理模型、词嵌入模型和视觉模型

主模型,建议选择综合能力强、参数较多的模型

推理模型,名称中一般包含“reasoner”、“R1”等关键词(普通模型也是没问题的)

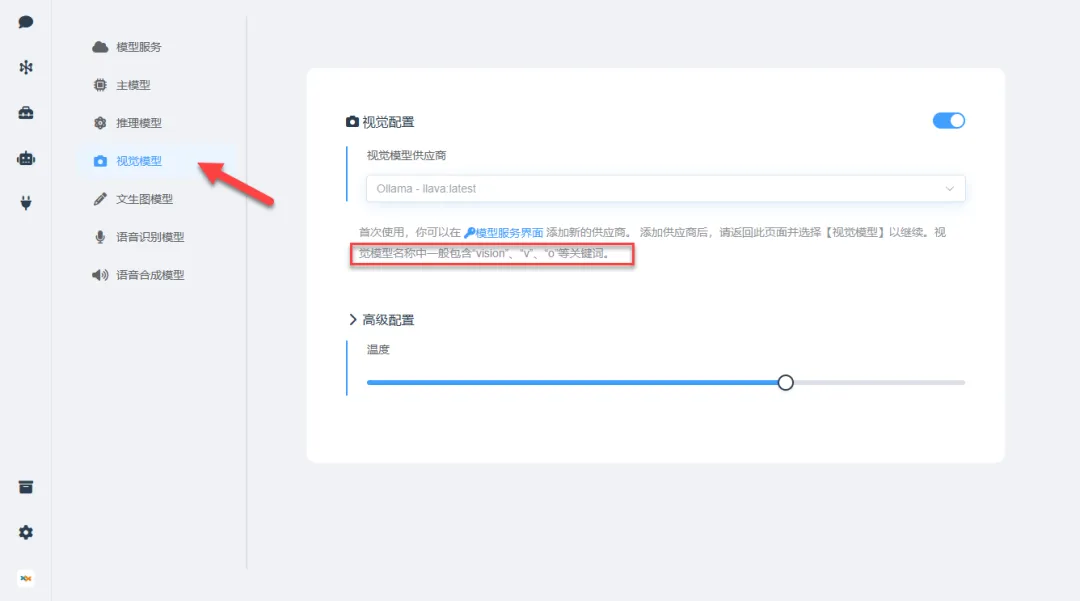

视觉模型,名称中一般包含“vision”、“v”、“o”等关键词(如果不需要上传图片识别功能,不需要配置)

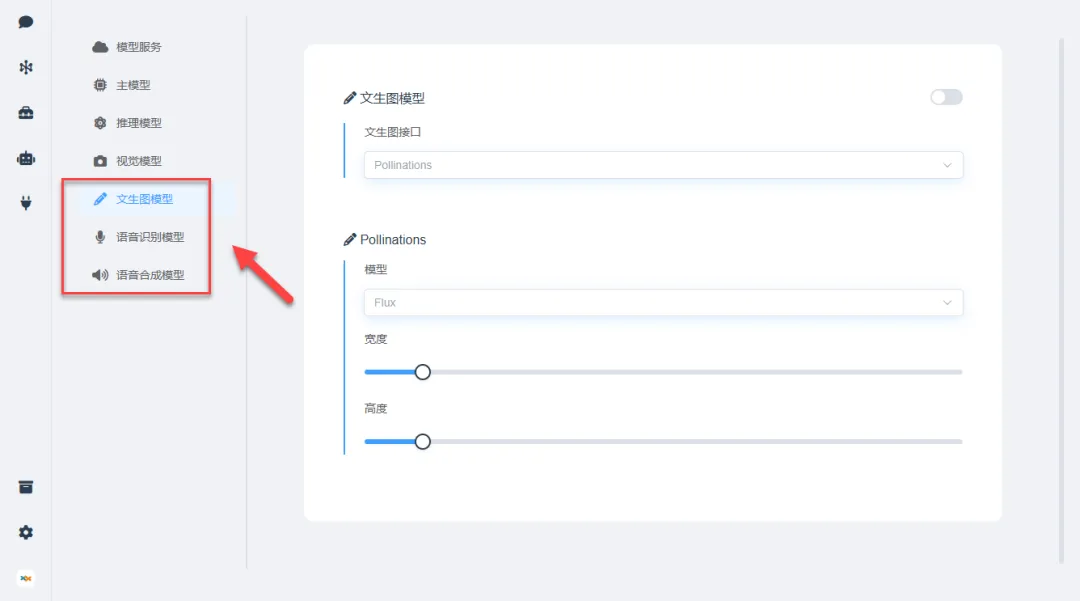

其他这些可以先不设置,默认就行

回到对话界面,发送消息测试一下是否能正常调用模型

展开下面工具栏,可以看到众多功能开关(开启状态显示为蓝色)

上传图片也是也能正常使用,不过没用独显回复速度会稍慢一些

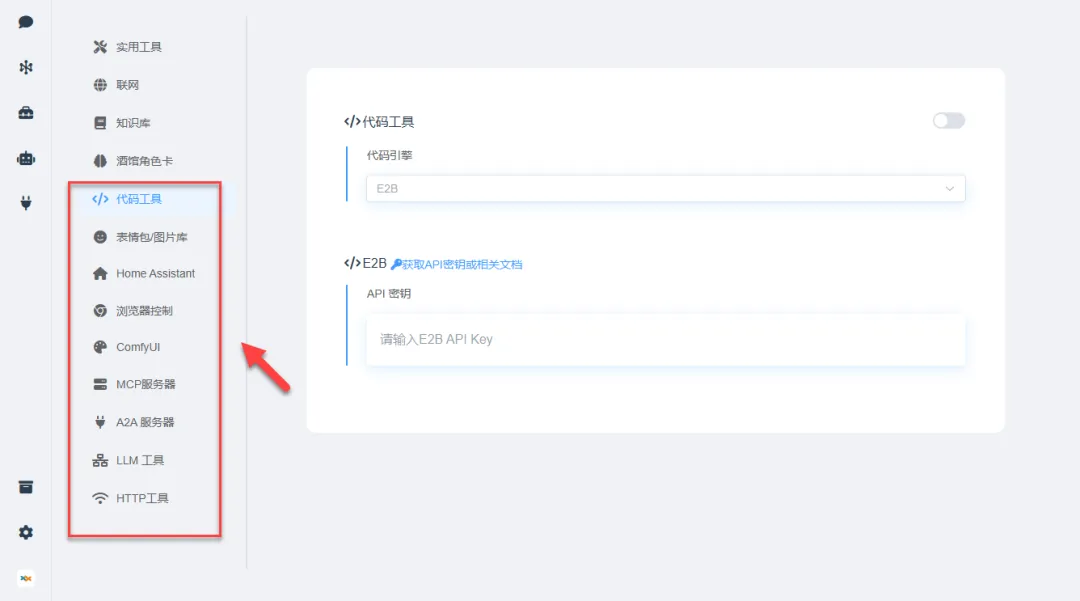

实用工具,目前支持扩展功能挺多的

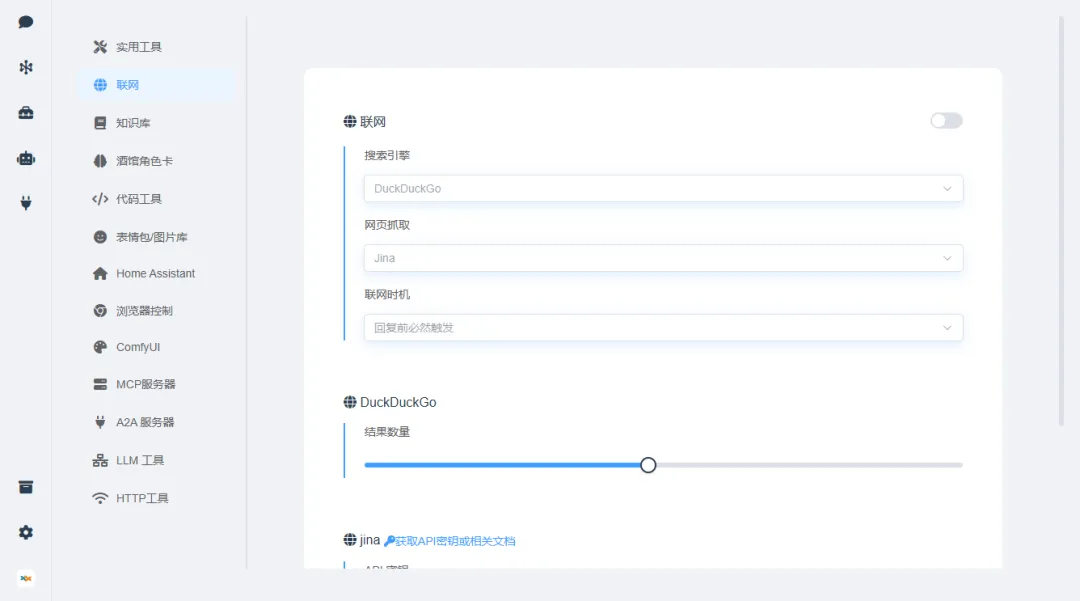

联网,需要额外配置 API 才行,这里我就不设置了

知识库,已经内置集成了,直接创建就能调用

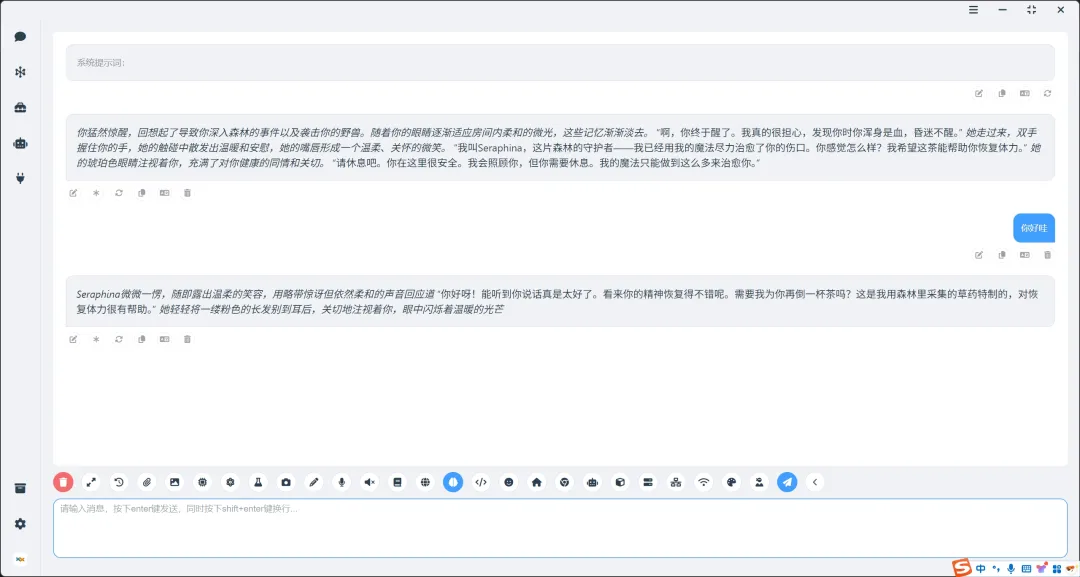

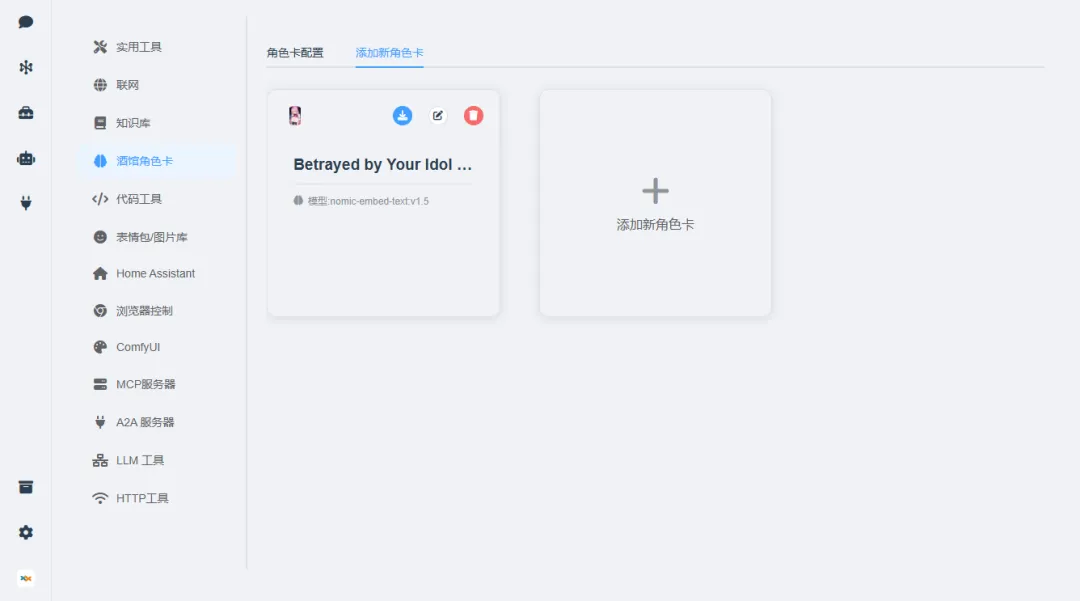

酒馆角色卡,这个懂得都懂就不多说了(不懂的,后续有空会出一期教程)

从网站下载角色后,导入时记得选择词嵌入模型(普通模型也是可以的)

可以看到已经可以代入角色了(若效果不行,可以换另外一个模型)

除此之外,下面还有很多功能我就不展开了

机器人,可以支持桌宠机器人,直播机器人,QQ 机器人,阅读机器人和通用配置

VRM 网页桌宠

还可以导入自己的 .vrm 格式模型

接口调用,开放内部接口,方便开发者对接

资源占用情况,基本上是不需要担心硬件负担,因为这里主要都是调用 API 实现功能的

总结

我之前也尝试部署过不少同类 AI 数字人工具,很多开发者最初都是凭着一腔热爱选择开源,但随着项目推进,不少最终转向了收费模式。而 Super Agent Party 目前不仅功能已相当完善,还始终坚持开源,这份初心尤为难得。如果后续能进一步拓展模型支持(比如加入 Live2D 模型),并实现情感驱动的动作反馈与口型匹配功能,相信体验会更上一层楼。可以预见,能进行自然交互的 AI 将是未来的重要发展方向,感兴趣的用户不妨亲自部署体验一番。

综合推荐:⭐⭐⭐⭐(有兴趣的,值得部署)

使用体验:⭐⭐⭐⭐(配置简单,扩展性强)

部署难易:⭐⭐(简单)