一、背景说明

2026年年初购入一台铭凡N5迷你主机,配置为:

- CPU:R7 255

- 显卡:Radeon 780M(板载,无独显)

- 内存:升级至 48GB

卸载原厂系统后更换为飞牛OS,存储功能完善稳定,设备长期开机运行。觉得硬件闲置浪费,遂尝试部署本地大模型。本文面向新手,尽量简化操作,减少命令行输入。

二、方案对比

方案1:使用飞牛自带的 ollama 套件

| 优点 |

缺点 |

| ollama + openwebui 组合套件,安装简单 |

版本较低,无法使用 qwen3.5 等新模型 |

结论:测试多次后,直接更新存在风险,怕弄崩系统,故卸载等待飞牛官方更新,目前飞牛官方已经更新,可以正常使用了。

方案2:使用 Docker 安装 ollama + 飞牛市场 lobechat

- lobechat 可直接通过飞牛市场安装

- 配置方式:在设置中找到 ollama,打开右侧开关,点击模型框下方文字即可搜索 ollama 模型

- 缺点:版本过低,最新版暂未找到安装源

方案3:使用 Docker 安装 ollama + openwebui(推荐方案,目前持续使用)

三、具体操作步骤

步骤一:下载镜像

1. ollama 镜像

打开飞牛 Docker,在镜像仓库搜索 ollama,选择第一个 ollama/ollama(官方源),点击右侧下载。默认 latest 即为最新版,下载速度可能较慢。

2. openwebui 镜像

openwebui 在镜像仓库中无官方源,需在本地镜像 → 添加镜像中添加下载链接:

- 地址:

ghcr.io/open-webui/open-webui:main

- 账号密码留空,点击确认等待下载(同样较慢)

3. ROCm 版本(可选)

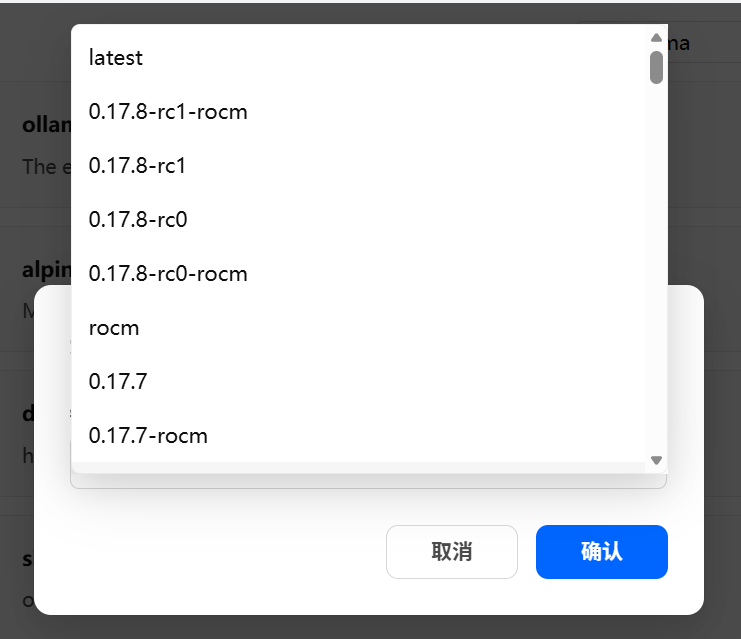

在出现latest的框的时候点击latest,会出现下拉框(如下图),那个rocm就是专门的优化版,就是这个源不知道为什么rocm刷不出最新版来,也可以直接本地镜像》添加镜像,比如说组新版,ollama/ollama:0.18.13-rocm,感觉应该拉取的就是最新的优化版了,当时下完之后我忘记在终端查版本是不是了。。。。懒得打就直接选下面那个0.17.8-rc1-rocm也可以。

步骤二:配置 ollama 容器

点击 ollama 镜像右侧箭头,创建容器:

| 配置项 |

设置值 |

说明 |

| 开机自动启动 |

✅ 勾选 |

- |

| 端口 |

11434 |

确保未被占用 |

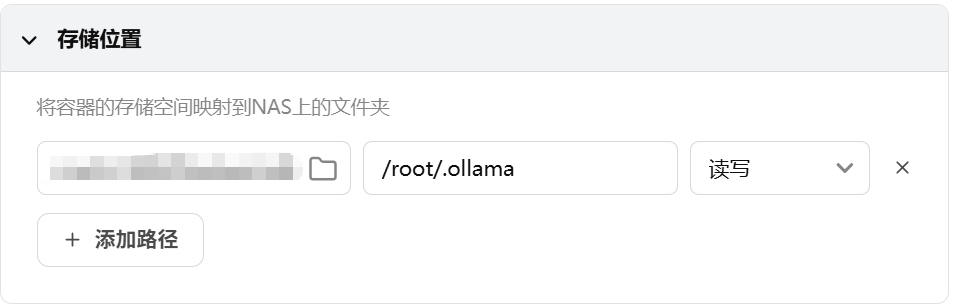

| 存储路径 |

自定义路径 →/root/.ollama/ |

建议选大容量磁盘 |

| 网络模式 |

host |

- |

环境变量配置:

OLLAMA_ORIGINS=* (必填)

OLLAMA_VULKAN=1 (启用 Vulkan)

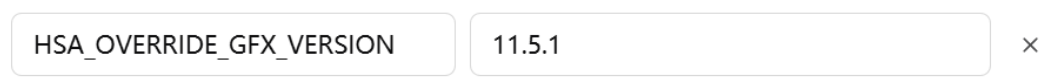

若使用 ROCm,需额外添加:

HSA_OVERRIDE_GFX_VERSION=11.0.0

⚠️ 注意:启用 ROCm 后需删除 Vulkan 变量,这个变量要看你的显卡是否支持ROCM,具体的地址是:AMD硬件编码,我的显卡是780M,我测试了一下填写11.0.0可以使用,如果填ai max395的那个11.5.1,就会报错。增加rocm变量的话,就要把vulkan的那个变量删掉。

功能选择:

可以不用选择高权限容器。这个需要在compose中进行映射,docker中需要映射宿主硬件的设备和驱动才能正常使用,在环境变量中应该调整不了,不会的话就直接高权限容器,等熟悉了再使用compose:

devices:

- /dev/kfd:/dev/kfd # ROCm 内核驱动设备,必需

- /dev/dri:/dev/dri # 直接渲染设备,Vulkan 必需

步骤三:配置 openwebui 容器

| 配置项 |

设置值 |

| 端口 |

3000:8080 |

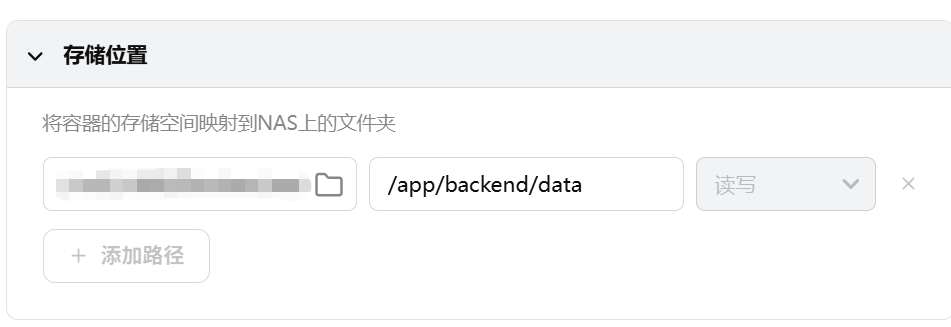

| 存储路径 |

同 ollama 配置 |

| 网络模式 |

bridge |

存储路径如下:和ollama一样,前面是选择的存放地点,后面如下

四:使用

如果是局域网使用,直接在飞牛地址后面加上:3000就行了。就会打开这个openwebui,如果要是fnconnect的话要点开docker》容器点箭头的位置,会有一个3000:8080的下拉框,点击一下就行。

**注意:**如果出现页面没有打开的情况,大概率是因为这个模型下载不了造成的,这个是自带的一个嵌入模型,做文档前期处理用的,把后面的字删掉应该就能打开了,别点X把整个字段删了。

五:说明

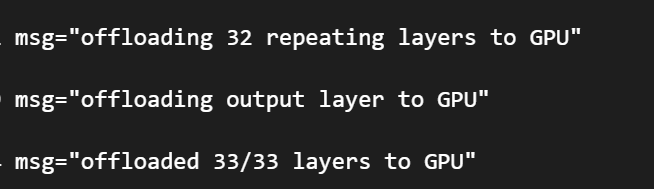

下图就是ollama日志中使用vulkan的日志输出情况,如果是rocm,会有专门的字样。

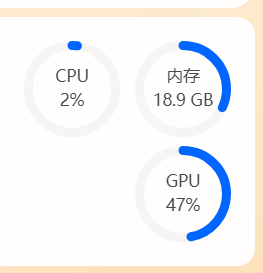

运行的qwen3.5:9b_q4,gpu运行效率

目前使用780m在ollama中试验过了好多的模型:

qwen3.5-9b-q4

8-12t左右,凑合能用,智商一般。

qwen3.5-27b-q4

3-5t左右,太慢了,智商很好。

qwen3.5-35b-a3b-q8

8-12t左右,目前在用的模型,不过这个模型要占36GB内存。智商在线。q4有一个排班的任务就过不去,q8就能过。

千问系列就是思考时间太长了,废话太多。

glm-4.7flash-q8

10-12t左右,非常快,q4更快,还算能用,但是排班的时候告诉我4月有31天。。。

lfm2-24b,贼快,20t以上,最高能跑到29t,就是没有思考模式,有时候和没有脑子一样。

nv新的模型我也试了,逻辑应该没有问题,速度还行但是中文理解或者说中文输出有问题也可能是我机器算力不够。

amd的olmo,感觉不冷不热的,非常慢。

llama的70b-q2,q3模型我都试了,会提示内存不够直接报错,应该和自动分配有关,同样容量的35b-a3b就能够正常加载。

2026年4月,更新一下如何使用llama

测试了好多遍,心里觉得llama的速度比ollama更快,而且模型精度可选的更多,在魔塔里面随便下,ollama录入gguf的模型总是有问题,不知道是不是我配置的问题,然后也试了一下localai,hf非常难连,使用魔塔能够正常使用,但是他自带了一个智能体,这个智能体各种问题,一生气就不用了,后来换成的阿里巴巴的qwenpaw,llama部署起来没有ollama方便,而且llama每次只能启动一个模型,如果使用向量检索就要启动两个llama,不知道是不是我没弄对。

也是使用docker进行部署,具体的部署方式和ollama没有啥区别

直接贴compose配置:

services:

llama:

image: ghcr.io/ggml-org/llama.cpp:server-vulkan #vulkan的server镜像,容量小,full容量太大。

container_name: llama

restart: unless-stopped

ports:

- 8082:8082/tcp

volumes:

- /vol1/1000/Dockers/llama/models:/models #这三个是存储位置,

- /vol1/1000/Dockers/llama/config:/app/config

- /vol1/1000/Dockers/llama/data:/app/data

devices:

- /dev/kfd:/dev/kfd # ROCm 内核驱动设备,必需

- /dev/dri:/dev/dri # 直接渲染设备,vulkan必需

networks:

- localNetwork

environment:

#- HIP_NO_VMM=0 #这个是调用rocm时候开的

#- HSA_OVERRIDE_GFX_VERSION=11.0.0 #这个是调用rocm时候开的

- GGML_VULKAN=1 # 【关键】强制启用 Vulkan 后端。

# 模型配置

#- LLAMA_AR**ODEL=/models/gemma-4-26B-A4B-**-I-Balanced.gguf

- LLAMA_AR**ODEL=/models/Qwen3.6-35B-A3B-Claude-4.6-Opus-Reasoning-Distilled-**-I-Balanced.gguf #在compose中必须要写模型的位置,需要先把模型下到电脑里面才行

# 服务器配置

#- LLAMA_ARG_CTX_SIZE=131072 #上下文长度,如果显存不够就得限制一下了

- LLAMA_ARG_FLASH_ATTN=1 #动态缓存压缩,据说有优化,但是没感觉出来

- LLAMA_ARG_PORT=8082

- LLAMA_ARG_HOST=0.0.0.0

# GPU 配置

- LLAMA_ARG_N_GPU_LAYERS=99 #这个是显卡层数,gemma好像是31,qwen41

- LLAMA_ARG_PARALLEL=4 #并行处理,降低数量可以减少内存

- LLAMA_ARG_CACHE_TYPE_K=q8_0 #缓存压缩,q8精度

- LLAMA_ARG_CACHE_TYPE_V=q8_0 #缓存压缩,q8精度

llama-embedding: #这个使用的是向量检索

image: ghcr.io/ggml-org/llama.cpp:server #向量检索使用的cpu,所以就用默认的server

container_name: llama-embedding

restart: unless-stopped

volumes:

- /vol1/1000/Dockers/llama/models:/models

networks:

- localNetwork

environment:

- LLAMA_AR**ODEL=/models/Qwen3-Embedding-0.6B-Q8_0.gguf #4b对于我来说有点大。

#- LLAMA_AR**ODEL=/models/Qwen3-Embedding-4B-Q4_K_M.gguf

# 服务器配置

- LLAMA_ARG_PORT=8081

- LLAMA_ARG_HOST=0.0.0.0

networks:

localNetwork:

external: true

driver: bridge

llama自带一个简单webui,对于日常对话来说够了。对话的时候可以现在每秒速度。

目前48GB内存,bios中分配给780M16GB显存,vulkan启动的时候可以动用大概32GB显存,rocm启动不知道为什么怎么都突破不了16GB,而且rocm对连续显存块有严格的要求,总之试了半天想要跑gemma26和qwen35都不行。vulkan就没有问题,我试了一下16GB一下的模型,vulkan推测和rocm大概差10%到20%的速度吧,大概就是20t和22t的区别应为速度不快,感觉不是很明显。

我是非常满意的。

Llama.cpp 速度实测:

| 模型 |

速度 |

| qwen3.5-27b-q4 |

4-5 t/s |

| qwen3.5-9b-q4 |

8-12 t/s |

| gemma26b-a4b-q5 |

19-20 t/s |

| qwen3.6-35b-a3b-q5 |

20-22 t/s |

20+ t/s 的对话速度已足够流畅,阅读速度跟不上输出速度,体验满意。

根据网上评测qwen3.6-35b-a3b已经可以部分超越27b了。

在使用qwen3.6-35b的时候链接qwenpaw是能够正常执行工具的,可以较为流畅的运行,但是编程我没有试,日常工作中没有涉及到编程的项目,更多的文字材料编写、文档的整理、网上爬信息、知识库、收发信息啥的,所以这个目前这个设置刚好能够满足我的要求。

然后我一直想买一块B50的显卡,但是目前似乎飞牛的支持不是很完整,最近一直在翻b站,发现对于16GB的显存的显卡,我感觉即使部署了,35b也不能完全放入到显存中,会因为cpu和内存的原因掉速度,我有一台2700的cpu+6750gre12G的台式机,像9b类的,机器可以跑23左右。但是如果是35b的模型,速度还没有现在的r7 255快。