应用中心安装NVIDIA Container Toolkit

第一步:验证基础环境

-

检查驱动库目录是否存在

ls -ld /usr/lib/x86_64-linux-gnu

-

检查核心驱动库文件是否存在

ls -l /usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1

-

检查显卡设备节点是否存在(补充:验证硬件可达)

ls -l /dev/nvidia0

第二步:修复权限

1.开放显卡设备访问权限

sudo chmod 666 /dev/nvidia*

2.开放NVIDIA驱动库权限

sudo chmod 755 /usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1

sudo chmod -R 755 /usr/lib/x86_64-linux-gnu/nvidia*

sudo chmod -R 755 /usr/lib/x86_64-linux-gnu/libnvidia*

sudo chmod -R 755 /usr/lib/x86_64-linux-gnu/libvdpau*

第三步:重启服务使配置生效

sudo ldconfig # 重新加载系统库缓存

sudo nvidia-ctk runtime configure --runtime=docker # 配置NVIDIA运行时

sudo systemctl restart docker # 重启Docker

第四步:部署启动Ollama容器

第一步.5 自行查权使用。

ollama要求:GLIBC ≥ 2.38,飞牛GLIBC 版本“getconf GNU_LIBC_VERSION“=glibc 2.36,所以sh进入容器会报错/bin/sh: /lib/x86_64-linux-gnu/libc.so.6: version `GLIBC_2.38' not found (required by /bin/sh)

日常用以下命令即可。

相关命令:GPU验证+模型管理、对话,

-

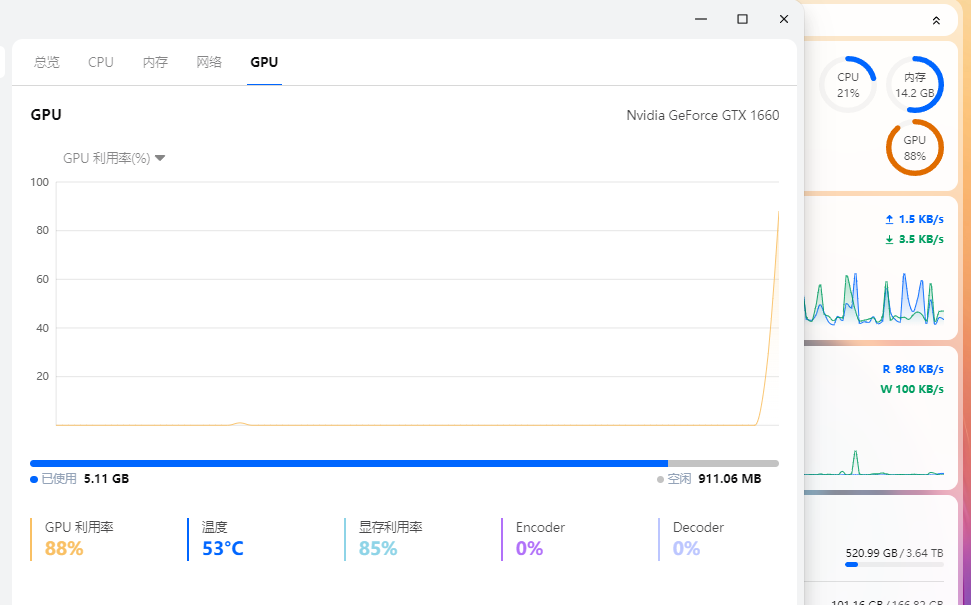

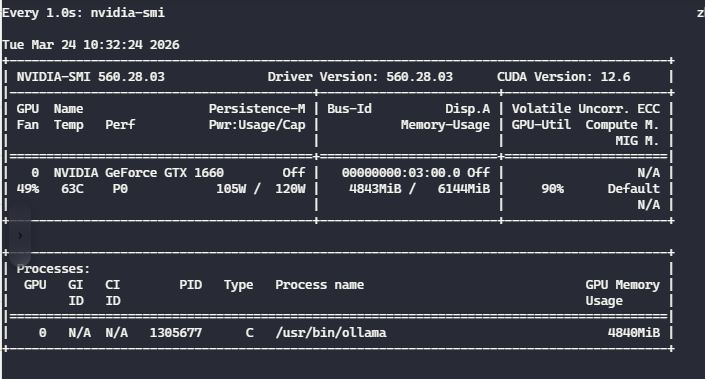

新开终端执行:监控GPU显存(实时看显存占用)

watch -n 1 nvidia-smi

-

查看已有的模型(确认持久化)

docker exec ollama ollama list

-

拉取模型(替换为实际模型名,如qwen3.5:9b)

docker exec ollama ollama pull qwen3.5:9b

-

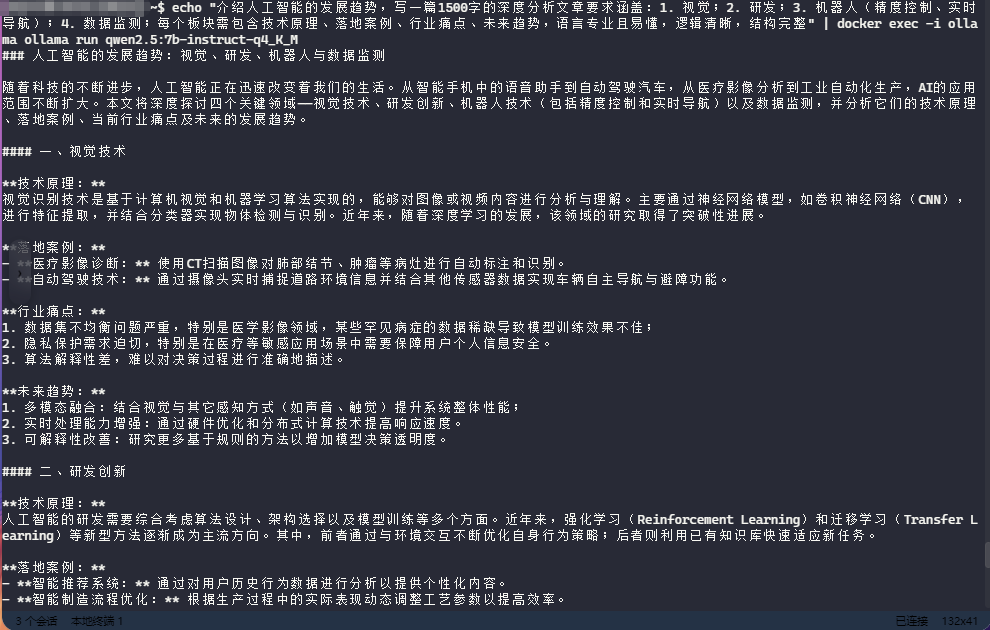

测试模型对话(验证GPU加速,补充:核心验证步骤)

echo "hi,请介绍一下自己" | docker exec -i ollama ollama run <你的模型>

docker-compose.yml示例

services:

ollama:

image: ollama/ollama:latest

container_name: ollama

restart: unless-stopped

privileged: true

volumes:

- ./ollama_data:/root/.ollama

- /usr/lib/x86_64-linux-gnu:/usr/lib/x86_64-linux-gnu

- /dev:/dev

environment:

- NVIDIA_VISIBLE_DEVICES=all

ports:

- "11434:11434"

deploy:

resources:

reservations:

devices: []