系统版本:X86

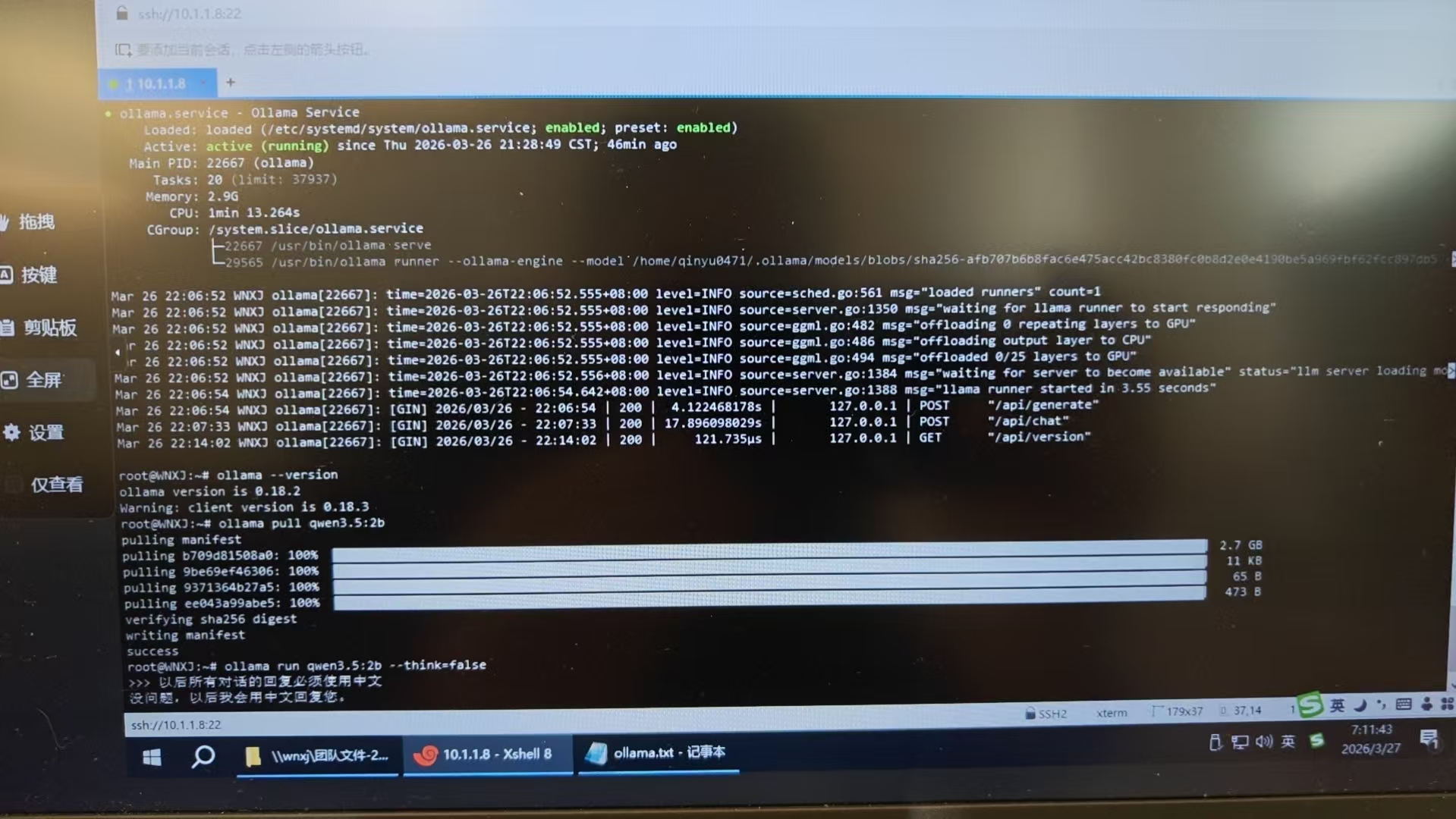

设备环境:物理机、局域网/公网、系统版本号:v1.1.26/openclaw版本号:0.08/ollama版本号:v18.3;

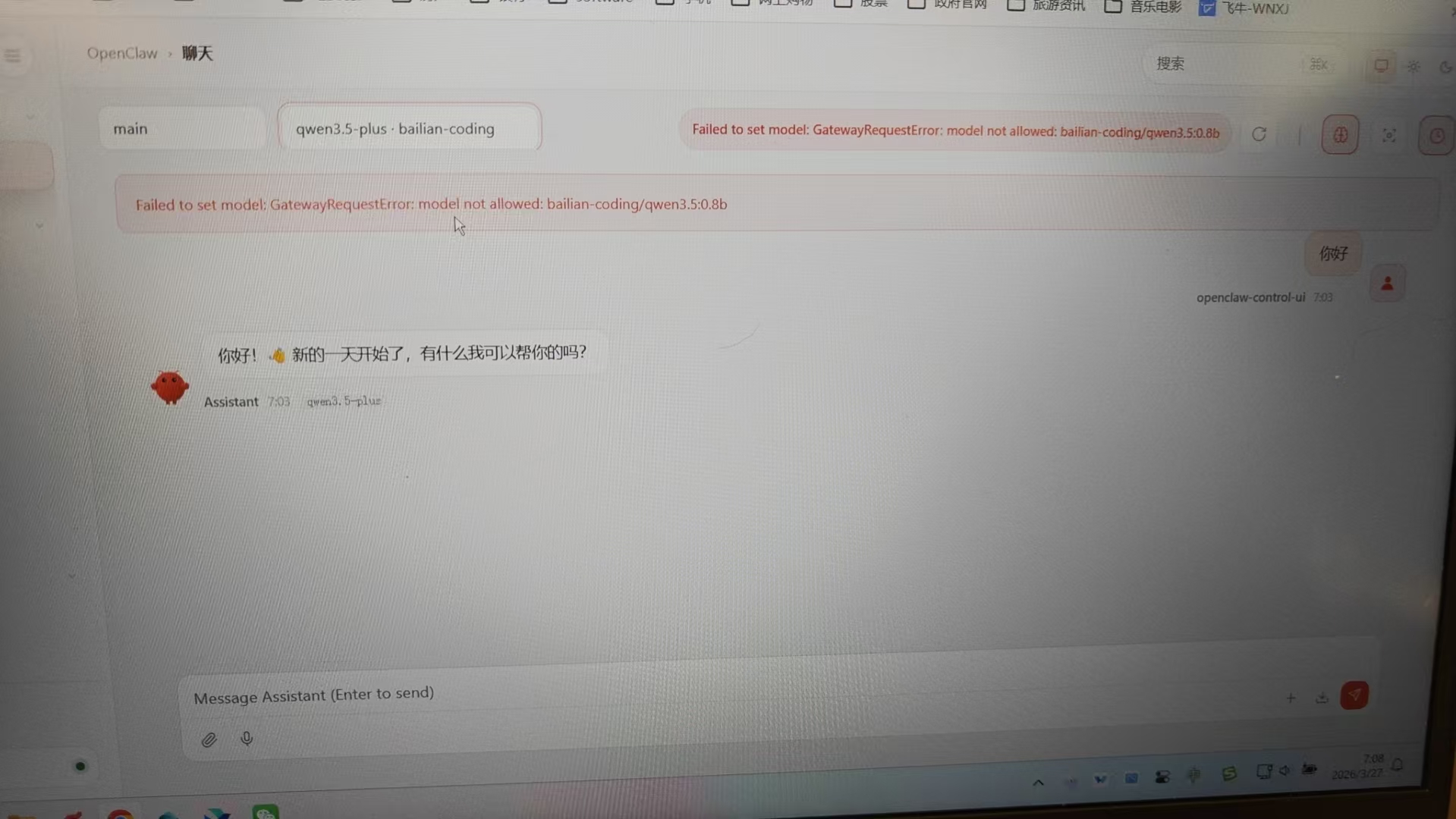

BUG现象:(使用ollama run qwen3.5:0.8b,可正确聊天,在飞牛openclaw中配置ollama能显示本地2个模型,配置完成后有重启飞牛opencalw,用飞牛opencalwl界面中"打开openclaw"按钮,在打开openclaw网页中的聊天,切换本地ollama/qwen3.5:0.8b模型,界面提示"设置模型失败:GatewayRequestError:不允许的模型:bailian-coding/qwen3.5:0.8b")

出现频率:(必现)

联系方式:(飞牛小龙虾用户群3-鲸鱼)

日志文件:

检查系统日志和飞牛openclaw日志中无错误日志