最近我做了一件挺有意思的事:把 OpenClaw 接到了手机上。

视频演示地址:

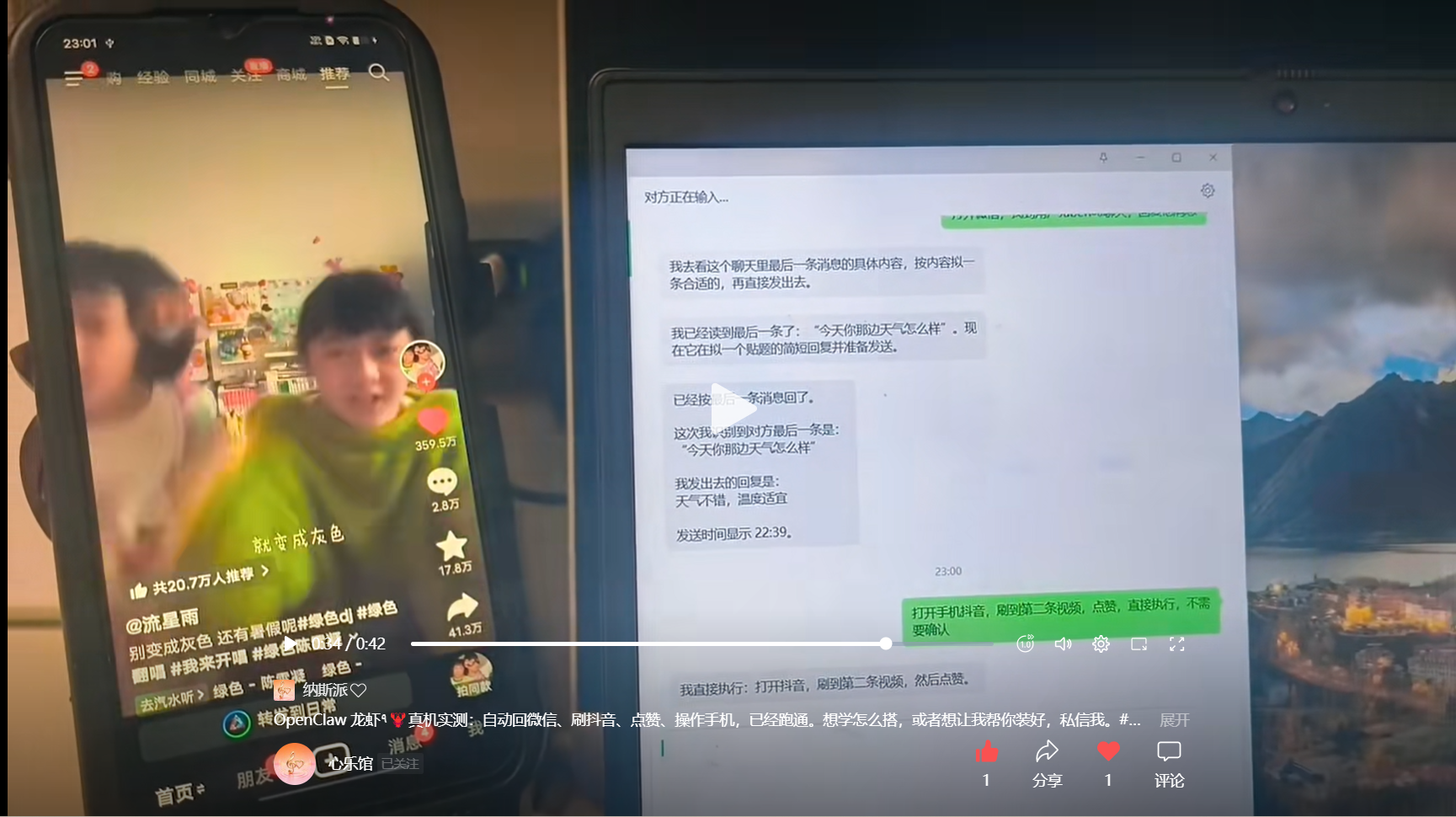

3.56 复制打开抖音,看看【AI创绘🍭的作品】OpenClaw 真机实测:自动回微信、刷抖音、点... https://v.douyin.com/Goqsr2qRXuQ/ B@G.iC 04/11 Agb:/

不是让 AI 只会聊天,也不是只负责告诉你下一步该怎么点,而是让它真正去看懂手机界面,然后自己完成点击、滑动、输入、跳转等动作。

这次主要用到的项目,是智谱开源的 Open-AutoGLM。

它本质上是一个 Phone Agent 框架:通过视觉理解手机界面,再结合 ADB 控制设备,完成整套操作流程。

项目地址:https://github.com/zai-org/Open-AutoGLM

而我这次做的事情,是把它进一步和 OpenClaw🦞 接到一起。

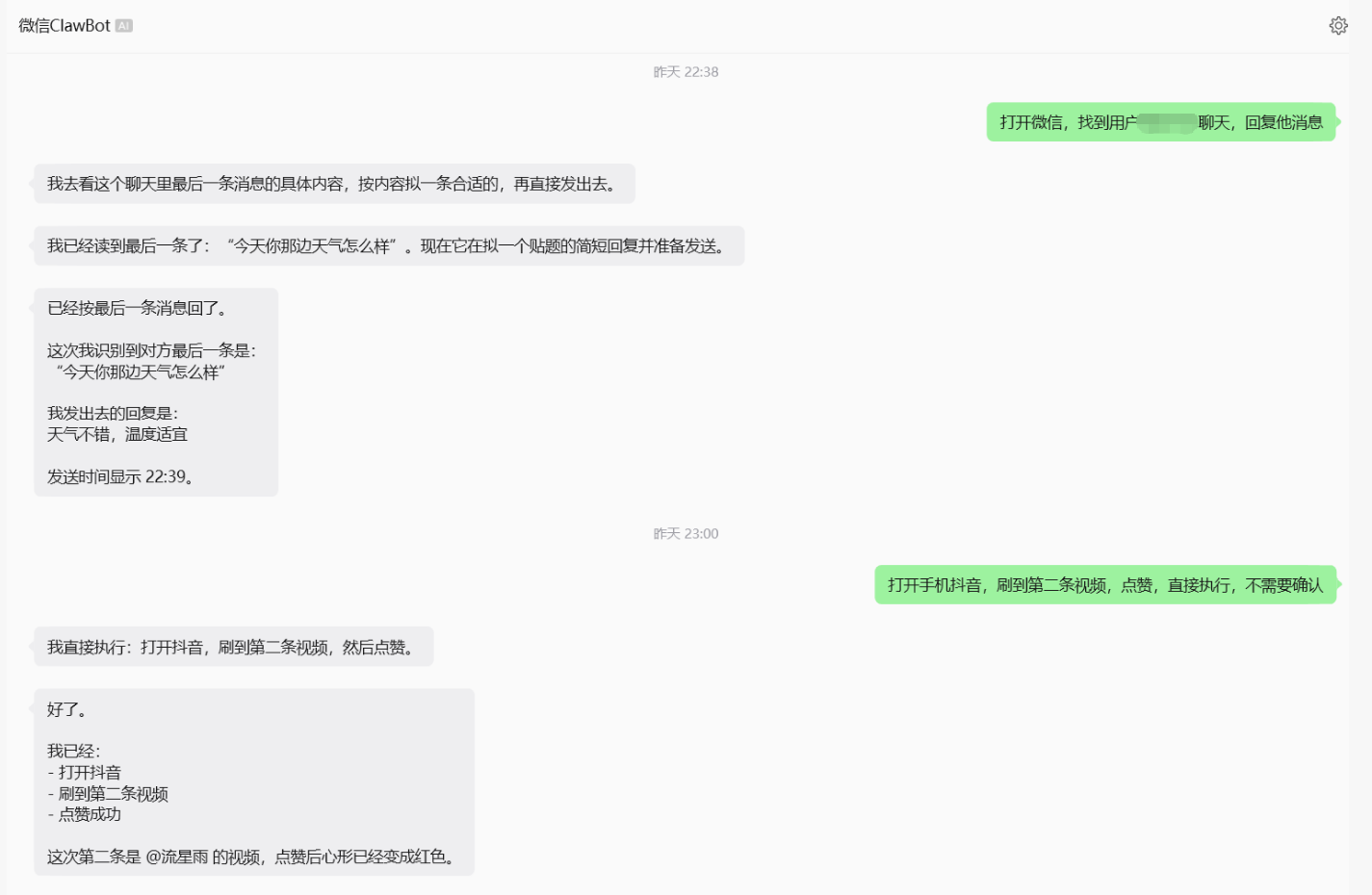

这样一来,OpenClaw🦞 可以通过 微信、飞书,或者其它通讯_Bot 接收指令,再去控制已经连上的手机执行任务。

这套方案怎么工作?

简单说,它不是“把 OpenClaw🦞 装进手机里”,而是通过一套 通讯入口 + OpenClaw🦞 调度 + 手机执行 的协同方式来完成操作。

整个链路可以理解为:

- 用户通过 微信、飞书,或者其它通讯_Bot 发送指令

- OpenClaw🦞 接收并理解任务

- 接入 Open-AutoGLM

- 手机通过 ADB 与电脑连接

- 模型读取当前手机界面截图

- 判断下一步该执行什么操作

- 再由手机完成点击、滑动、输入、跳转等动作

- 执行结果再返回到通讯_Bot消息入口

也就是说,它不是传统那种写死坐标的脚本,而是更接近一种基于视觉理解的 手机代理(Phone Agent)。

它会先判断当前页面是什么、按钮在哪里、是否有弹窗干扰、操作有没有成功,然后再继续下一步。

这次演示跑通了什么?

我这次主要实测了几类场景:

1)微信自动操作

- 打开微信

- 找到指定联系人

- 发送消息

- 查看最后一条聊天内容

- 基于上下文生成回复并发送

2)抖音自动操作

- 打开抖音

- 刷到第 N 条视频

- 自动点赞

- 处理中途弹窗

- 流程被打断后继续恢复

3)手机基础控制

这些能力组合起来,说明它已经不只是“演示点几下按钮”,而是开始具备一些真实可落地的手机操作能力。

这套能力的想象空间,其实不止微信

如果只是把它理解成“微信自动回复”或者“抖音自动点赞”,那还是把这套能力看窄了。

一旦链路真正打通,OpenClaw🦞 相当于拥有了一台自己的“手机”。

它不只是能收消息、回消息,而是可以像真人一样,直接去操作手机上的各种 App。

比如,它可以:

- 在 大众点评 里搜索餐厅、查看结果、继续执行后续操作

- 在 小红书 里打开页面、整理内容、发布笔记

- 去操作你手机里已经安装的其它应用

- 通过消息入口接收任务,再到手机端完成整个执行过程

你可以把它理解成:

给 OpenClaw🦞 AI助手装上了一双真正能操作手机的手。

这样一来,AI的能力边界就不再只是“会聊天、会写字、会回答问题”,

而是进一步变成了:它能在手机这个终端上,替你完成一部分真实动作。

这件事真正有意思的地方在于,它给了 AI 一个更接近“数字分身”的形态。

比如最直接的一个想象就是:

可以给它单独创建自己的微信

也就是说,它可以作为一个独立微信账号加入群聊,像一个真人一样去参与对话。

你可以提前用自然语言给它设定规则,比如:

- 在什么情况下回应

- 在什么情况下保持安静

- 遇到什么话题该怎么说

- 应该扮演一个什么样的角色

- 回答的语气、边界和风格是什么

这样一来,它就不只是一个放在后台的工具,而更像一个真正可被调度、可被设定、可参与互动的智能体。

当然,微信只是其中一个入口。

真正的想象空间在于:只要手机上有对应的 App,理论上就存在被接入、被编排、被自动执行的可能。

项目本身的应用覆盖也比较广

这也是我觉得它不只是一个 Demo 的原因之一。

根据 Open-AutoGLM 项目介绍,Phone Agent 已支持 50+ 款主流中文应用,覆盖的类别包括:

| 分类 |

代表应用 |

| 社交通讯 |

微信、QQ、微博 |

| 电商购物 |

淘宝、京东、拼多多 |

| 美食外卖 |

美团、饿了么、肯德基 |

| 出行旅游 |

携程、12306、滴滴出行 |

| 视频娱乐 |

bilibili、抖音、爱奇艺 |

| 音乐音频 |

**云音乐、QQ 音乐、喜马拉雅 |

| 生活服务 |

大众点评、高德地图、百度地图 |

| 内容社区 |

小红书、知乎、豆瓣 |

这意味着它并不是只能在单个 App 里做孤立演示,而是已经具备了一定的跨应用执行基础。

这套工作流程的优势是什么?

我觉得这套方案最大的价值,不是单个功能有多炫,而是它代表了一种新的工作方式:

OpenClaw🦞 不只是会回答问题,而是开始具备执行能力。

相比传统手机自动化,这套方式有几个明显优势:

- 不依赖写死坐标,适应界面变化能力更强

- 能结合视觉理解做判断,不是机械执行

- 能处理一部分弹窗和中断场景

- 可接入微信、飞书、ClawBot 等通讯入口,远程下发任务更自然

- 更容易扩展到不同 App 和不同任务流程

说白了,它更像“让 OpenClaw🦞 AI成为手机操作员”,而不只是一个聊天机器人。

它的局限也很明显

当然,这套方案现在还不是万能的,局限也很现实:

- 依赖电脑端运行,不是纯手机独立方案

- 依赖 ADB 连接稳定性

- 手机最好保持亮屏

- 不同机型、不同 App 页面需要适配

- App 更新后可能要重新调

- 复杂场景下仍然会有误判概率

- 平台风控也会影响实际可用边界

所以它更适合的是:

流程明确、频率不高、允许人工兜底、可以持续维护优化 的自动化任务。

最后

从这次实测来看,这个方向我觉得是成立的。

它已经不是单纯的 Demo,而是一个可以继续往落地方案推进的雏形。

尤其是在 OpenClaw🦞 已经可以连接微信、飞书、等通讯入口 的前提下,这套能力的使用门槛会进一步降低:

你不一定非得坐在电脑前,也可以直接通过消息入口发指令,让已经连上的手机去执行任务。

如果你也想自己搭一套,或者想直接把 微信自动回复、抖音自动操作、手机基础控制、通讯入口远程调度 这类能力跑起来,我这边也可以提供 代部署、调试和适配支持。

如果你想自己部署,我可以继续整理完整流程和避坑清单;

如果你想直接落地,我也可以帮你 代搭、代调、代跑通。

👥 NAS 折腾交流群

如果你也在折腾 NAS / OpenClaw🦞 / AI自动化流程,欢迎关注私信微信公众号"纳斯派"进群一起交流。