系统版本:

X86

设备环境:

物理机、局域网、

系统版本号:

V1.1.26;

BUG现象:

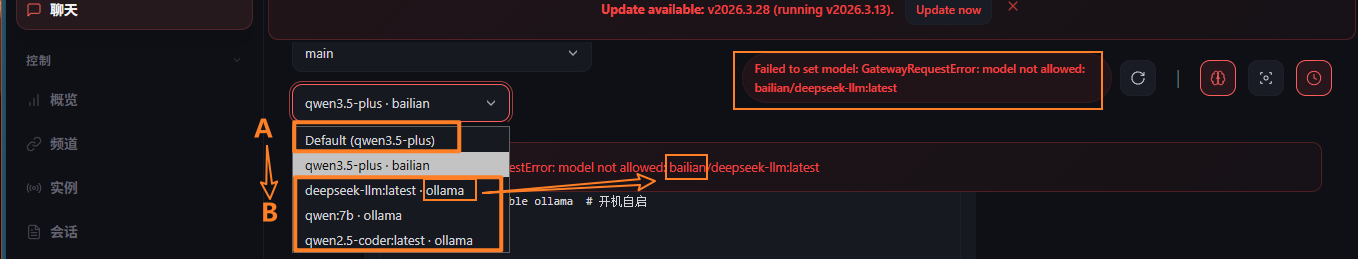

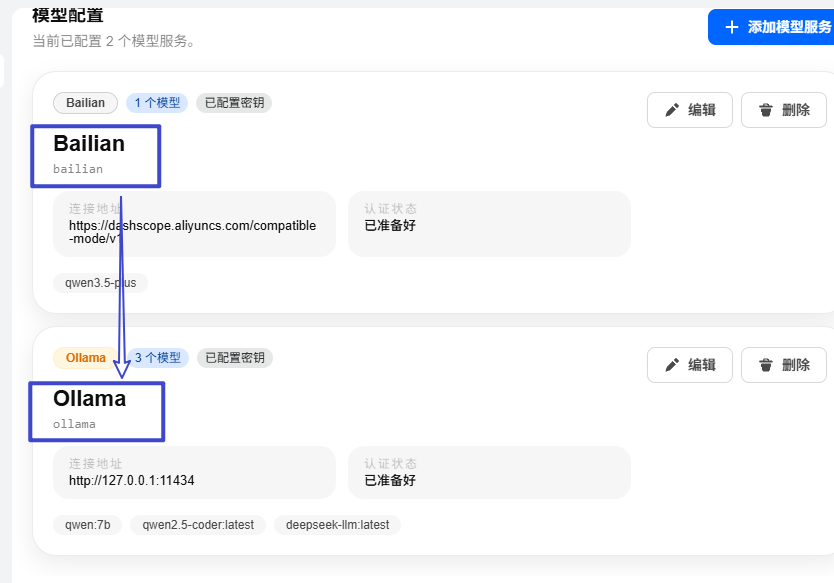

在同一台服务器部署了 OpenClaw 和 ollama,配置了本地模型 deepseek-llm:latest ,但从【qwen3.5plus·bailian】切换到【deepseek-llm:latest·ollama】时报错 Failed to set model: GatewayRequestError: model not allowed: bailian/deepseek-llm:latest,错误信息里显示的模型名称却是

bailian/deepseek-llm:latest,实际在调用阿里云而非本地ollama。

如图:

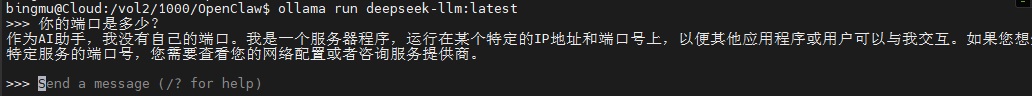

ollama运行正常:如图

出现频率:

必现

联系方式:

粉丝群昵称:飞牛小龙虾用户群31-冰木

日志文件:

APP端 BUG:未见错误日志